Исследование операций

ГЛАВА 1

ПРЕДМЕТ И ЗАДАЧИ ИССЛЕДОВАНИЯ ОПЕРАЦИЙ

§ 1. Что такое исследование операций и чем оно занимается

В наше время, которое по справедливости называют эпохой научно-технической революции, наука уделяет все большее внимание вопросам организации и управления. Причин этому много. Быстрое развитие и усложнение техники, небывалое расширение масштабов проводимых мероприятий и спектра их возможных последствий, внедрение автоматизированных систем управления (АСУ) во все области практики — все это приводит к необходимости анализа сложных целенаправленных процессов под углом зрения их структуры и организации. От науки требуются рекомендации по оптимальному (разумному) управлению такими процессами. Прошли времена, когда правильное, эффективное управление находилось организаторами «на ощупь», методом «проб и ошибок». Сегодня для выработки такого управления требуется научный подход — слишком велики потери, связанные с ошибками.

Потребности практики вызвали к жизни специальные научные методы, которые удобно объединять под названием «исследование операций». Под этим термином мы будем понимать применение математических, количественных методов для обоснования решений во всех областях целенаправленной человеческой деятельности.

Поясним, что понимается под «решением». Пусть предпринимается какое-то мероприятие, направленное к достижению определенной цели. У лица (или группы лиц), организующего мероприятие, всегда имеется какая-то свобода выбора: оно может организовать его тем или другим способом, например, выбрать образцы техники, которые будут применены, так или иначе распределить имеющиеся средства и т. д. «Решение» это и есть какой-то выбор из ряда возможностей, имеющихся у организатора. Решения бывают плохими

и хорошими, продуманными и скороспелыми, обоснованными и произвольными.

Необходимость принятия решений так же стара, как само человечество. Несомненно, уже в доисторические времена первобытные люди, отправляясь, скажем, охотиться на мамонта, должны были принимать те или другие решения: в каком месте устроить засаду? Как расставить охотников? Чем их вооружить? и т.

д. Мы с вами в повседневной жизни, сами того не замечая, на каждом шагу принимаем решения. Например, выходя утром из дому, чтобы идти на работу, мы должны принять целый ряд решений: как одеться? Брать ли с собой зонтик? В каком месте перейти улицу? Каким видом транспорта воспользоваться? и т. д. Руководитель предприятия тоже должен постоянно принимать решения типа: как распорядиться имеющейся рабочей силой? Какие типы работ выполнить в первую очередь? и т. д.

Значит ли это, что, принимая подобные решения, мы занимаемся «исследованием операций»? Нет, не значит. Исследование операций начинается тогда, когда для обоснования решений применяется тот или другой математический аппарат. До поры до времени решения в любой области практики принимаются без специальных математических расчетов, просто на основе опыта и здравого смысла. Скажем, для решения вопроса о том, как одеться, выходя на улицу, и где ее перейти, математика не нужна, да и вряд ли потребуется в дальнейшем. Оптимизация таких решений происходит как бы сама собой, в процессе жизненной практики. Если порой принятое решение окажется не самым удачным, так что же? На ошибках учатся!

Однако бывают решения куда более ответственные. Пусть, например, организуется работа общественного транспорта в новом городе с сетью предприятий, жилыми массивами и т. д. Необходимо принять ряд решений: по каким маршрутам и какие транспортные средства направить? В каких пунктах сделать остановки? Как изменять частоту следования машин в зависимости от времени суток? и т. д.

Эти решения — гораздо сложнее, а главное, от них очень многое зависит. Неправильный их выбор может отразиться на деловой жизни целого города. Конечно, и в этом случае при выборе решения можно действовать интуитивно, опираясь на опыт и здравый смысл (так оно нередко и делается). Но гораздо разумнее будут решения, если они подкреплены математическими расчетами. Эти предварительные расчеты помогут избежать длительного и дорогостоящего поиска нужного решения «на ощупь».

Возьмем еще более яркий пример. Пусть речь идет о каком-то очень крупномасштабном мероприятии — скажем, об отведении части стока северных рек в засушливые зоны. Допустимо ли здесь произвольное, «волевое» решение, могущее привести к серьезным отрицательным последствиям, или же необходима серия предварительных расчетов по математическим моделям? Думается, что здесь двух мнений быть не может — необходимость тщательных, многосторонних расчетов очевидна.

«Семь раз примерь, один — отрежь», — говорит пословица. Исследование операций как раз и есть своеобразное математическое «примеривание» будущих решений, позволяющее экономить время, силы и материальные средства, избегать серьезных ошибок, на которых уже нельзя «учиться» (слишком дорого это обходится).

Чем сложнее, дороже, масштабнее планируемое мероприятие, тем менее допустимы в нем «волевые» решения и тем важнее становятся научные методы, позволяющие заранее оценить последствия каждого решения, заранее отбросить недопустимые варианты и рекомендовать наиболее удачные; установить, достаточна ли имеющаяся у нас информация для правильного выбора решения, и если нет — какую информацию нужно получить дополнительно. Слишком опасно в таких случаях опираться па свою интуицию, на «опыт и здравый смысл». В нашу эпоху научно-технической революции техника и технология меняются настолько быстро, что «опыт» просто не успевает накапливаться. К тому же часто идет речь о мероприятиях уникальных, проводимых впервые. «Опыт» в этом случае молчит, а «здравый смысл» легко может обмануть, если не опирается на расчет. Такими расчетами, облегчающими людям принятие решений, и занимается исследование операций.

Как уже говорилось, это — сравнительно молодая наука (хотя понятие «молодости» в научном мире относительно; многие, едва возникшие науки «истлевают на корню», так и не найдя приложений). Впервые название «исследование операций» появилось в годы второй мировой войны, когда в вооруженных силах некоторых стран (США, Англии) были сформированы специальные группы научных работников (физиков, математиков, инженеров), в задачу которых входила подготовка проектов решений для командующих боевыми действиями.

Эти решения касались главным образом боевого применения оружия и распределения сил и средств по различным объектам. Подобного рода задачами (правда, под иными названиями) занимались и ранее, в частности, в нашей стране. В дальнейшем исследование операций расширило область своих применений на самые разные области практики: промышленность, сельское хозяйство, строительство, торговля, бытовое обслуживание, транспорт, связь, здравоохранение, охрана природы и т. д. Сегодня трудно назвать такую область практики, где бы не применялись, в том или другом виде, математические модели и методы исследования операций.

Чтобы познакомиться со спецификой этой науки, рассмотрим ряд типичных для нее задач. Эти задачи, намеренно взятые из самых разных областей практики, несмотря на некоторую упрощенность постановки, дают все же понятие о том, каков предмет и каковы цели исследования операций.

1. План снабжения предприятий. Имеется ряд предприятий, потребляющих известные виды сырья, и есть ряд сырьевых баз, которые могут поставлять это сырье предприятиям. Базы связаны с предприятиями какими-то путями сообщения (железнодорожными, водными, автомобильными, воздушными) со своими тарифами. Требуется разработать такой план снабжения предприятий сырьем (с какой базы, в каком количестве и какое сырье доставляется), чтобы потребности в сырье были обеспечены при минимальных расходах на перевозки.

2. Постройка участка магистрали. Сооружается участок железнодорожной магистрали. В нашем распоряжении — определенное количество средств: людей,. строительных машин, ремонтных мастерских, грузовых автомобилей и т. д. Требуется спланировать строительство (т. е. назначить очередность работ, распределить машины и людей по участкам пути, обеспечить ремонтные работы) так, чтобы оно было завершено в минимально возможный срок.

3. Продажа сезонных товаров. Для реализации определенной массы сезонных товаров создается сеть временных торговых точек. Требуется выбрать разумным образом: число точек, их размещение, товарные запасы и количество персонала па каждой из них так, чтобы обеспечить максимальную экономическую эффективность распродажи.

4. Снегозащита дорог. В условиях Крайнего Севера метели, заносящие снегом дороги, представляют серьезную помеху движению. Любой перерыв движения приводит к экономическим потерям. Существует ряд возможных способов снегозащиты (профиль дороги, защитные щиты и т. д.), каждый из которых требует известных затрат на сооружение и эксплуатацию. Известны господствующие направления ветров, есть данные о частоте и интенсивности снегопадов. Требуется разработать наиболее эффективные экономически средства снегозащиты (какую из дорог, как и чем, защищать?) с учетом потерь, связанных с заносами.

5. Противолодочный рейд. Известно, что в некотором районе морского театра военных действий находится подводная лодка противника. Группа самолетов противолодочной обороны получила задание: разыскать, обнаружить и уничтожить лодку. Требуется рационально организовать операцию (рейд): выбрать маршруты самолетов, высоту полета, способ атаки так, чтобы с максимальной уверенностью обеспечить выполнение боевого задания.

6. Выборочный контроль продукции. Завод выпускает определенного вида изделия. Для обеспечения их высокого качества организуется система выборочного контроля. Требуется разумно организовать контроль (т. е. выбрать размер контрольной партии, набор тестов, правила браковки и т. д.) так, чтобы обеспечить заданный уровень качества при минимальных расходах на контроль.

7. Медицинское обследование. Известно, что в каком-то районе обнаружены случаи опасного заболевания. С целью выявления заболевших (или носителей инфекции) организуется медицинское обследование жителей района. На это выделены материальные средства, оборудование, медицинский персонал. Требуется разработать такой план обследования (число медпунктов, их размещение, последовательность осмотров специалистами, виды анализов и т. д.), который позволит выявить, по возможности, максимальный процент заболевших и носителей инфекции.

8. Библиотечное обслуживание. Крупная библиотека обслуживает запросы, поступающие от абонентов. В фондах библиотеки имеются книги, пользующиеся повышенным спросом, книги, на которые требования поступают реже и, наконец, книги, почти никогда не запрашиваемые.

Имеется ряд возможностей распределения книг по стеллажам и хранилищам, а также по диспетчеризации запросов с обращениями в другие библиотеки. Нужно разработать такую систему библиотечного обслуживания, при которой запросы абонентов удовлетворяются в максимальной мере.

Число примеров легко было бы умножить, но и приведенных достаточно, чтобы представить себе характерные особенности задач исследования операций. Хотя примеры относятся к самым различным областям, в них легко просматриваются общие черты. В каждом из них речь идет о каком-то мероприятии, преследующем определенную цель. Заданы некоторые условия, характеризующие обстановку (в частности, средства, которыми мы можем распоряжаться). В рамках этих условий требуется принять такое решение, чтобы задуманное мероприятие было в каком-то смысле наиболее выгодным.

В соответствии с этими общими чертами вырабатываются и общие приемы решения подобных задач, в совокупности, составляющие методологическую схему и аппарат исследования операций.

Внимательный читатель, знакомясь с приведенными выше примерами, вероятно, заметил, что не для всех из них на практике применяются математические методы обоснования решений; в некоторых случаях решения принимаются по старинке, на глаз. Однако с течением времени доля задач, где для выбора решения применяются математические методы, постоянно растет. Особенно большую роль приобретают эти методы по мере внедрения АСУ (автоматизированных систем управления) во все области практики. Создание АСУ (если она применяется для управления, а не только для сбора и обработки информации) невозможно без предварительного обследования управляемого процесса методами математическою моделирования. С ростом масштабов и сложности мероприятий математические методы обоснования решений приобретают все большую роль. Работа небольшого аэродрома вполне может быть обеспечена силами одного опытного диспетчера; работа крупного аэропорта требует автоматизированной системы управления, работающей согласно четкому алгоритму.

Выработка такого алгоритма всегда основывается на предварительных расчетах, т. е. на исследовании операций.

§ 2. Основные понятия и принципы исследования операций

В этом параграфе мы познакомимся с терминологией, основными понятиями и принципами науки «исследование операций».

Операцией называется всякое мероприятие (система действий), объединенное единым замыслом и направленное к достижению какой-то цели (все мероприятия, рассмотренные в пунктах 1 — 8 предыдущего параграфа, являются «операциями»).

Операция есть всегда управляемое мероприятие, т. е. от нас зависит, каким способом выбрать некоторые параметры, характеризующие её организацию. «Организация» здесь понимается в широком смысле слова, включая набор технических средств, применяемых в операции.

Всякий определенный выбор зависящих от нас параметров называется решением. Решения могут быть удачными и неудачными, разумными и неразумными. Оптимальными называются решения, по тем или другим признакам предпочтительные перед другими. Цель исследования операций — предварительное количественное обоснование оптимальных решений.

Иногда (относительно редко) в результате исследования удается указать одно-единственное строго оптимальное решение, гораздо чаще — выделить область практически равноценных оптимальных (разумных) решений, в пределах которой может быть сделан окончательный выбор.

Заметим, что само принятие решения выходит за рамки исследования операции и относится к компетенции ответственного лица, чаще — группы лиц, которым предоставлено право окончательного выбора и на которых возложена ответственность за этот выбор. Делая выбор, они могут учитывать, наряду с рекомендациями, вытекающими из математического расчета, еще ряд соображений (количественного и качественного характера), которые этим расчетом не были учтены.

Непременное присутствие человека (как окончательной инстанции, принимающей решение) не отменяется даже при наличии полностью автоматизированной системы управления, которая, казалось бы, принимает решение без участия человека.

Нельзя забывать о том, что само создание управляющего алгоритма, выбор одного из возможных его вариантов, есть тоже решение, и весьма ответственное. По мере развития управляющих автоматов функции человека не отменяются, а просто перемещаются с одного, элементарного, уровня на другой, высший. Кроме того, ряд автоматизированных систем управления предусматривает в ходе управляемого процесса активное вмешательство человека.

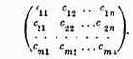

Те параметры, совокупность которых образует решение, называются элементами решения. В качестве элементов решения могут фигурировать различные числа, векторы, функции, физические признаки и т. д. Например, если составляется план перевозок однородных грузов из пунктов отправления А1,А2,…, Аm в пункты назначения В1,В2, ..., Вn, то элементами решения будут числа xij, показывающие, какое количество груза будет отправлено из 1-го пункта отправления Аi в j-й пункт назначения Вj. Совокупность чисел x11, x12, …, x1n, …, xm1, xm2, …, xmn образует решение.

В простейших задачах исследования операций количество элементов решения может быть сравнительно невелико. Но в большинстве задач, имеющих практическое значение, число элементов решения очень велико, в чем читатель может убедиться, попытавшись самостоятельно выделить и «назвать по имени» элементы решения в примерах 1 — 8 предыдущего параграфа. Для упрощения мы будем всю совокупность элементов решения обозначать одной буквой x и говорить «решение х».

Кроме элементов решения, которыми мы, в каких-то пределах, можем распоряжаться, в любой задаче исследования операций имеются еще и заданные, «дисциплинирующие» условия, которые фиксированы с самого начала и нарушены быть не могут (например, грузоподъемность машины; размер планового задания;

весовые характеристики оборудования и т. п.). В частности, к таким условиям относятся средства (материальные, технические, людские), которыми мы вправо распоряжаться, и иные ограничения, налагаемые на решение. В своей совокупности они формируют так называемое «множество возможных решений».

Обозначим это множество опять-таки одной буквой X, а тот факт, что решение х принадлежит этому множеству, будем записывать в виде формулы: х

(читается: элемент х входит в множество X).

Речь идет о том, чтобы в множестве возможных решений Х выделить те решения х (иногда — одно, а чаще — целую область решений), которые с той или другой точки зрения эффективнее (удачнее, предпочтительнее) других. Чтобы сравнивать между собой по эффективности разные решения, нужно иметь какой-то количественный критерий, так называемый показатель эффективности (его часто называют «целевой функцией»). Этот показатель выбирается так, чтобы он отражал целевую направленность операции. «Лучшим» будет считаться то решение, которое в максимальной степени способствует достижению поставленной цели. Чтобы выбрать, «назвать по имени» показатель эффективности W, нужно, прежде всего, спросить себя: чего мы хотим, к чему стремимся, предпринимая операцию? Выбирая решение, мы, естественно, предпочтем такое, которое обращает показатель эффективности W в максимум (или же в минимум). Например, доход от операции хотелось бы обратить в максимум; если же показателем эффективности являются затраты, их желательно обратить в минимум. Если показатель эффективности желательно максимизировать, мы это будем записывать в виде W => mах, а если минимизировать — W => min.

Очень часто выполнение операции сопровождается действием случайных факторов («капризы» погоды, колебания спроса и предложения, отказы технических устройств и т. д.). В таких случаях обычно в качестве показателя эффективности берется не сама величина, которую хотелось бы максимизировать (минимизировать), а ее среднее значение (математическое ожидание).

В некоторых случаях бывает, что операция, сопровождаемая случайными факторами, преследует какую-то вполне определенную цель А,

которая может быть только достигнута полностью или совсем не достигнута (схема «да—нет»), и никакие промежуточные результаты нас не интересуют. Тогда в качестве показателя эффективности выбирается вероятность достижения этой цели Р(А). Например, если ведется стрельба по какому-то объекту с непременным условием уничтожить его, то показателем эффективности будет вероятность уничтожения объекта.

Неправильный выбор показателя эффективности очень опасен. Операции, организованные под углом зрения неудачно выбранного критерия, могут привести к неоправданным затратам и потерям (вспомним хотя бы пресловутый «вал» в качестве основного критерия оценки хозяйственной деятельности предприятий).

Для иллюстрации принципов выбора показателя эффективности вернемся опять к примерам 1 — 8 § 1, выберем для каждого из них естественный показатель эффективности и укажем, требуется его максимизировать или минимизировать. Разбирая примеры, нужно иметь в виду, что не во всех из них выбор показателя эффективности однозначно диктуется словесным описанием задачи, так что по этому вопросу возможны расхождения между читателем и автором.

1. План снабжения предприятий. Задача операции — обеспечить снабжение сырьем при минимальных расходах на перевозки. Показатель эффективности R — суммарные расходы на перевозки сырья за единицу времени, например, месяц (R =>

min).

2. Постройка участка магистрали. Требуется так спланировать строительство, чтобы закончить его как можно скорее. Естественным показателем эффективности было бы время завершения стройки, если бы оно не было связано со случайными факторами (отказы техники, задержки в выполнении отдельных работ). Поэтому в качестве показателя эффективности можно выбрать среднее ожидаемое время Т

окончания стройки (Т => min).

3. Продажа сезонных товаров. В качестве показателя эффективности можно взять среднюю ожидаемую прибыль П от реализации товаров за сезон (П => mах).

4. Снегозащита дорог. Речь идет о наиболее выгодном экономически плане снегозащиты, поэтому в качестве показателя эффективности можно выбрать средние за единицу времени (например, за год) расходы R на содержание и эксплуатацию дорог, включая расходы, связанные как с сооружением защитных устройств, так и с расчисткой дорог и задержками транспорта (R => min).

5. Противолодочный рейд. Так как рейд имеет вполне определенную цель А — уничтожение лодки, то в качестве показателя эффективности следует выбрать вероятность Р(A) того, что лодка будет уничтожена.

6. Выборочный контроль продукции. Естественный показатель эффективности, подсказанный формулировкой задачи, это средние ожидаемые расходы R на контроль за единицу времени, при условии, что система контроля обеспечивает заданный уровень качества, например, средний процент брака не выше заданного (R => min).

7. Медицинское обследование. В качестве показателя эффективности можно выбрать средний процент (долю) Q больных и носителей инфекции, которых удалось выявить (Q =>

шах).

8. Библиотечное обслуживание. В формулировке задачи сознательно допущена некоторая нечеткость:

неясно, что значит «наилучшее обслуживание абонентов» или «удовлетворение их запросов в максимальной мере». Если о качестве обслуживания судить по времени, которое запросивший книгу абонент ждет ее получения, то в качестве показателя эффективности можно взять среднее время Т

ожидания книги читателем, подавшим на нее заявку (Т => min). Можно подойти к вопросу и с несколько иных позиций, выбрав в качестве показателя эффективности среднее число М книг, выданных за единицу времени (М => mах).

Рассмотренные примеры специально подобраны настолько простыми, чтобы выбор показателя эффективности был сравнительно нетруден и прямо диктовался словесной формулировкой задачи, ее (почти всегда) однозначной целевой направленностью. Однако на практике это далеко не всегда бывает так. В этом читатель может убедиться, попытавшись, например, выбрать показатель эффективности работы городского транспорта. Что взять в качестве такого показателя? Среднюю скорость передвижения пассажиров по городу? Или среднее число перевезенных пассажиров? Или среднее количество километров, которое придется пройти пешком человеку, которого транспорт не может доставить к нужному месту? Тут есть над чем поразмыслить!

К сожалению, в большинстве задач, имеющих практическое значение, выбор показателя эффективности не прост и решается неоднозначно. Для сколько-нибудь сложной задачи типично положение, когда эффективность операции не может быть исчерпывающим образом охарактеризована одним единственным числом — на помощь ему приходится привлекать другие.

С такими «многокритериальными» задачами мы познакомимся в § 6.

§ 3. Математические модели операций

Для применения количественных методов исследования в любой области всегда требуется какая-то математическая модель. При построении модели реальное явление (в нашем случае — операция) неизбежно упрощается, схематизируется, и эта схема («макет» явления) описывается с помощью того или другого математического аппарата. Чем удачнее будет подобрана математическая модель, чем лучше она будет отражать характерные черты явления, тем успешнее будет исследование и полезнее — вытекающие из него рекомендации.

Общих способов построения математических моделей не существует. В каждом конкретном случае модель выбирается исходя из вида операции, ее целевой направленности, с учетом задачи исследования (какие параметры требуется определить и влияние каких факторов отразить). Необходимо также в каждом конкретном случае соразмерять точность и подробность модели: а) с той точностью, с которой нам нужно знать решение, и б) с той информацией, которой мы располагаем или можем приобрести. Если исходные данные, нужные для расчетов, известны неточно, то, очевидно, нет смысла входить в тонкости, строить очень подробную модель и тратить время (свое и машинное) на тонкую и точную оптимизацию решения. К сожалению, этим принципом часто пренебрегают и выбирают для описания явлений слишком подробные модели.

Математическая модель должна отражать важнейшие черты явления, все существенные факторы, от которых в основном зависит успех операции. Вместе с тем, модель должна быть по возможности простой, не «засоренной» массой мелких, второстепенных факторов: их учет усложняет математический анализ и делает труднообозримыми результаты исследования. Две опасности всегда подстерегают составителя модели: первая — увязнуть в подробностях («из-за деревьев не увидеть леса») и вторая—слишком огрубить явление («выплеснуть вместе с водой и ребенка»). Искусство строить математические модели есть именно искусство, и опыт в нем приобретается постепенно.

Поскольку математическая модель не вытекает с непреложностью из описания задачи, всегда полезно не верить слепо ни одной модели, а сличать результаты, полученные по разным моделям, устраивать как бы «спор моделей». При этом одну и ту же задачу решают не один раз, а несколько, пользуясь разной системой допущений, разным аппаратом, разными моделями. Если научные выводы от модели к модели меняются мало — это серьезный аргумент в пользу объективности исследования. Если они существенно расходятся, надо пересмотреть концепции, положенные в основу различных моделей, посмотреть, какая из них более адекватна действительности, в случае надобности — поставить контрольный эксперимент. Характерным для исследования операций является также повторное обращение к модели (после того, как первый тур расчетов уже проведен) для внесения в модель коррективов.

Создание математической модели — самая важная и ответственная часть исследования, требующая глубокого знания не столько математики, сколько существа моделируемых явлений. Как правило, «чистые» математики (без помощи специалистов в той области, к которой относится задача) с построением модели справляются плохо. В центре внимания у них оказывается математический аппарат с его тонкостями, а не реальная практическая задача.

Опыт показывает, что самые удачные модели создаются специалистами в данной области практики, получившими, в дополнение к основной, глубокую математическую подготовку, или же коллективами, объединяющими практиков-специалистов и математиков. Большую пользу приносят консультации, даваемые математиком, хорошо знающим исследование операций, практикам — инженерам, биологам, медикам и др., встречающимся в своей работе с необходимостью научного обоснования решений. От таких консультаций выигрывают не только практики, но и сам математик, знакомящийся с реальными задачами из самых разных областей. Для решения таких задач ему нередко приходится пополнять свое образование, а также развивать, обобщать и модифицировать известные ему методы.

Математическая подготовка специалиста, желающего самостоятельно (без посторонней помощи) заниматься исследованием операций в своей области практики, должна быть достаточно широка. Наряду с классическими разделами математического анализа (обычно проходимыми в вузе) в исследовании операций часто применяются современные, сравнительно новые разделы математики, такие, как линейное, нелинейное, динамическое программирование, теория игр и статистических решений, теория массового обслуживания и др. Некоторое понятие об этих разделах математики читатель может почерпнуть из нашей книги.

Специально надо подчеркнуть необходимость сведений по теории вероятностей — не столько обширных и глубоких, сколько неформальных, действенных, наличие привычки к оперированию со статистическими данными и вероятностными представлениями. Особые требования именно к этой области математических знаний объясняются тем, что большинство операций проводится в условиях неполной определенности, и их ход и исход зависят от случайных факторов. К сожалению, в широких кругах специалистов — инженеров, биологов, медиков, химиков — хорошее владение теорией вероятностей встречается редко. Ее положения и правила часто применяются формально, без подлинного понимания их смысла и духа. Нередко на теорию вероятностей смотрят как на некое подобие «волшебной палочки», позволяющее получить информацию «из ничего», из полного незнания. Это заблуждение: теория вероятностей позволяет только преобразовывать информацию, т. е. из сведений об одних явлениях, доступных наблюдению, делать выводы о других, недоступных. Наличие элементарных сведений по теории вероятностей предполагается у читателя этой книги.

Очень не хочется, чтобы перечисление разделов математики, применяемых в исследовании операций, запугало начинающего читателя и отбило у него охоту заниматься такими задачами. Во-первых, как говорится, не боги горшки обжигают, и любым аппаратом можно овладеть, если он действительно нужен. Во-вторых, не в каждой задаче применяются все перечисленные разделы; знакомиться можно не со всеми сразу, а с самыми необходимыми.

Какие знания по математике для каких задач нужны — можно опять-таки узнать из этой книги.

При построении математической модели может быть (в зависимости от вида операции, задач исследования и точности исходных данных) использован математический аппарат различной сложности. В самых простых случаях явление описывается простыми, алгебраическими уравнениями. В более сложных, когда требуется рассмотреть явление в динамике, применяется аппарат дифференциальных уравнений (обыкновенных или с частными производными). В наиболее сложных случаях, когда развитие операции, и ее исход зависят от большого числа сложно переплетающихся между собой случайных факторов, аналитические методы вообще отказываются служить, и применяется метод статистического моделирования (Монте-Карло), о котором будет идти речь в гл. 7. В первом, грубом приближении идею этого метода можно описать так: процесс развития операции, со всеми сопровождающими его случайностями, как бы «копируется», воспроизводится на машине (ЭВМ). В результате получается один экземпляр («реализация») случайного процесса развития операции со случайным ходом и исходом. Сама по себе одна такая реализация не дает оснований к выбору решения, но, получив множество таких реализации, мы обрабатываем его как обычный статистический материал (отсюда и термин «статистическое моделирование»), находим средние характеристики процесса и получаем представление о том, как в среднем влияют на них условия задачи и элементы решения.

В исследовании операций широко применяются как аналитические, так и статистические модели. Каждый из этих типов имеет свои преимущества и недостатки. Аналитические модели более грубы, учитывают меньшее число факторов, всегда требуют каких-то допущений и упрощений. Зато результаты расчета по ним легче обозримы, отчетливее отражают присущие явлению основные закономерности. А, главное, аналитические модели больше приспособлены для поиска оптимальных решений.

Статистические модели, по сравнению с аналитическими, более точны и подробны, не требуют столь грубых допущений, позволяют учесть большое (в теории — неограниченно большое) число факторов.

Но и у них — свои недостатки: громоздкость, плохая обозримость, большой расход машинного времени, а главное, крайняя трудность поиска оптимальных решений, которые приходится искать «на ощупь», путем догадок и проб.

Молодые специалисты, чей опыт в исследовании операций мал, имея в распоряжении вычислительные машины, часто без особой нужды начинают исследование с построения статистической модели, стараясь учесть в ней как можно больше факторов. Они забывают, что построить модель и произвести по ней расчеты — это полдела; важнее суметь проанализировать результаты и перевести их в ранг «рекомендаций».

Наилучшие работы в области исследования операций основаны на совместном применении аналитических и статистических моделей. Аналитическая модель дает возможность в общих чертах разобраться в явлении, наметить как бы «контур» основных закономерностей. Любые уточнения могут быть получены с помощью статистических моделей (подробнее см. главу 7).

В заключение скажем несколько слов о так называемом «имитационном» моделировании. Оно применяется к процессам, в ход которых может время от времени вмешиваться человеческая воля. Человек (или группа людей), руководящий операцией, может, в зависимости от сложившейся обстановки, принимать те или другие решения, подобно тому, как шахматист, глядя на доску, выбирает свой очередной ход. Затем приводится в действие математическая модель, которая показывает, какое ожидается изменение обстановки в ответ на это решение и к каким последствиям оно приведет спустя некоторое время. Следующее «текущее решение» принимается уже с учетом реальной новой обстановки и т. д. В результате многократного повторения такой процедуры руководитель как бы «набирает опыт», учится на своих и чужих ошибках и постепенно выучивается принимать правильные решения — если не оптимальные, то почти оптимальные. Такие процедуры, известные под названием «деловых игр», стали за последнее время очень популярными и, несомненно, полезны в деле подготовки управляющих кадров.

ГЛАВА 2

РАЗНОВИДНОСТИ ЗАДАЧ ИССЛЕДОВАНИЯ ОПЕРАЦИЙ И ПОДХОДОВ К ИХ РЕШЕНИЮ

§ 4. Прямые и обратные задачи исследования операций. Детерминированные задачи

Задачи исследования операций делятся на две категории: а) прямые и б) обратные. Прямые задачи отвечают на вопрос: что будет, если в заданных условиях мы примем какое-то решение х

Для решения такой задачи строится математическая модель, позволяющая выразить один или несколько показателей эффективности через заданные условия и элементы решения.

Обратные задачи отвечают на вопрос: как выбрать решение х для того, чтобы показатель эффективности W обратился в максимум?

Естественно, прямые задачи проще обратных. Очевидно также, что для решения обратной задачи, прежде всего надо уметь решать прямую. Для некоторых типов операций прямая задача решается настолько просто, что ею специально не занимаются. Для других типов операций построение математических моделей и вычисление показателя (показателей) эффективности само по себе далеко не тривиально (так, например, обстоит дело с прямыми задачами теории массового обслуживания, с которыми мы встретимся в главе 6).

Остановимся несколько подробнее на обратных задачах. Если число возможных вариантов решения, образующих множество X. невелико, то можно попросту вычислить величину W для каждого из них, сравнить между собой полученные значения и непосредственно указать один или несколько оптимальных вариантов, для которых W

достигает максимума. Такой способ нахождения оптимального решения называется «простым перебором». Однако, когда число возможных вариантов решения, образующих множество X, велико, поиск среди них оптимального «вслепую», простым перебором, затруднителен, а зачастую практически невозможен. В этих случаях применяются методы «направленного перебора», обладающие той общей особенностью, что оптимальное решение находится рядом последовательных «попыток» или «приближений», из которых каждое последующее приближает нас к искомому оптимальному.

С некоторыми из таких методов мы познакомимся в главах 3 и 4.

Сейчас мы ограничимся постановкой задачи оптимизации решения (обратной задачи исследования операций) в самой общей форме.

Пусть имеется некоторая операция O, на успех которой мы можем в какой-то мере влиять, выбирая тем или другим способом решение х (напомним, что х — не число, а целая группа параметров). Пусть эффективность операции характеризуется одним показателем W => max.

Возьмем самый простой, так называемый «детерминированный» случай, когда все условия операции полностью известны заранее, т. е. не содержат неопределенности. Тогда все факторы, от которых зависит успех операции, делятся на две группы:

1) заданные, заранее известные факторы (условия выполнения операции), которые мы для краткости обозначим одной буквой а;

2) зависящие от нас элементы решения, образующие в своей совокупности решение х.

Заметим, что первая группа факторов содержит, в частности, и ограничения, налагаемые на решение, т. е. определяет область возможных решений X.

Показатель эффективности W зависит от обеих групп факторов. Это мы запишем в виде формулы:

При рассмотрении формулы (4.1) не надо забывать, что как х, так и ос в общем случае — не числа, а совокупности чисел (векторы), функции и т. д. В числе заданных условий к обычно присутствуют ограничения, налагаемые на элементы решения, имеющие вид равенств или неравенств.

Будем считать, что вид зависимости (4.1) нам известен, т. е. прямая задача решена. Тогда обратная задача формулируется следующим образом.

При

заданном комплексе условий

Этот максимум мы обозначим:

Формула (4.2) читается так: W* есть максимальное значение W(

К формулам такого типа надо привыкать. Они понадобятся в дальнейшем (см. гл. 4).

Итак, перед нами — типичная Математическая Задача нахождения максимума функции или функционала.

Эта задача принадлежит к классу так называемых «вариационных задач», хорошо разработанных в математике. Самые простые из таких задач («задачи на максимум и минимум») знакомы каждому инженеру. Чтобы найти максимум или минимум (короче, «экстремум») функции многих аргументов, надо продифференцировать ее по всем аргументам (в данном случае — элементам решения), приравнять производные нулю и решить полученную систему уравнений. Казалось бы, чего проще? А вот этот классический метод как раз в исследовании операций имеет весьма ограниченное применение. Во-первых, когда аргументов много, задача решения системы уравнений зачастую оказывается не проще, а сложнее, чем непосредственный поиск экстремума. Во-вторых, когда на элементы решения наложены ограничения, экстремум часто достигается не в точке, где производные равны нулю (такой точки может вообще не быть), а где-то на границе области X. Возникают все специфические трудности так называемой «многомерной вариационной задачи при ограничениях», иной раз непосильной по своей сложности даже для современных ЭВМ. Кроме того, в некоторых задачах функция W вообще не имеет производных (например, задана только для целочисленных значений аргументов). Все это делает задачу поиска экстремума далеко не такой простои, как она кажется с первого взгляда.

Метод поиска экстремума и связанного с ним оптимального решения х* должен всегда выбираться исходя из особенностей функции W и вида ограничений, накладываемых на решение. Например, если функция W линейно зависит от элементов решения x1, x2, ..., а ограничения, налагаемые на x1, x2, ..., имеют вид линейных равенств или неравенств, возникает ставшая классической задача линейного программирования, которая решается сравнительно простыми, а главное, стандартными методами (см. главу 3). Если функция W выпукла, применяются специальные методы выпуклого программирования с их разновидностью:

«квадратичным программированием» (см. [8]). Для оптимизации управления многоэтапными операциями применяется метод динамического программирования (см.

главу 4). Наконец, существует целый набор численных методов отыскания экстремумов, специально приспособленных для реализации на ЭВМ; некоторые из них включают элемент «случайного поиска», который для многомерных задач нередко оказывается эффективнее упорядоченного перебора.

Таким образом, задача нахождения оптимального решения в простейшем, детерминированном случае есть чисто математическая задача, принадлежащая к классу вариационных (при отсутствии или наличии ограничений), которая может представить вычислительные, но не принципиальные трудности. Не так обстоит дело в случае, когда задача содержит элемент неопределенности.

§ 5. Проблема выбора решения в условиях неопределенности

В предыдущем параграфе мы рассмотрели обратную задачу исследования операций в детерминированном случае, когда показатель эффективности W зависит только от двух групп факторов: заданных, заранее известных а и элементов решения х. Реальные задачи исследования операций чаще всего содержат помимо этих двух групп еще одну — неизвестные факторы, которые в совокупности мы обозначим одной буквой ?. Итак, показатель эффективности W

зависит от всех трех групп факторов:

W=W(a, х, ?). (5.1)

Так как величина W зависит от неизвестных факторов ? то даже при заданных

При заданных условиях

Это уже другая, не чисто математическая задача (недаром в ее формулировке сделана оговорка «по возможности»).

Наличие неопределенных факторов ? переводит задачу в новое качество: она превращается в задачу о выборе решения в условиях неопределенности.

Порассуждаем немного о возникшей задаче. Прежде всего, будем честны: неопределенность есть неопределенность, и ничего хорошего в ней нет. Если условия операции неизвестны, мы не можем так же успешно оптимизировать решение, как мы это сделали бы, если бы располагали большей информацией. Поэтому любое решение, принятое в условиях неопределенности, хуже решения, принятого в заранее известных условиях. Что делать? Плохое или хорошее — решение все равно должно быть принято. Наше дело — придать этому решению в возможно большей мере черты разумности. Недаром Т. Л. Саати, один из видных зарубежных специалистов по исследованию операций, определяя свой предмет, говорит не без иронии: «Исследование операций представляет собой искусство давать плохие ответы на практические вопросы, на которые даются еще худшие ответы другими методами».

Задача принятия решения в условиях неопределенности на каждом шагу встречается нам в жизни. Например, мы собрались путешествовать, и укладываем в чемодан вещи. Размеры и вес чемодана, а также имеющийся у нас набор вещей заданы (условия

Теперь возьмем более серьезную задачу. Планируется ассортимент товаров для распродажи на ярмарке. Желательно было бы максимизировать прибыль. Однако заранее неизвестно ни количество покупателей, которые придут на ярмарку, ни потребности каждого из них. Как быть? Неопределенность налицо, а принимать решение нужно!

Другой пример: проектируется система сооружений, оберегающих район от паводков. Ни моменты их наступления, ни размеры заранее неизвестны. А проектировать все-таки нужно, и никакая неопределенность не избавит нас от этой обязанности...

Наконец, еще более сложная задача: разрабатывается план развития вооружения на несколько лет вперед. Неизвестны ни конкретный противник, ни вооружение, которым он будет располагать. А решение принимать надо!

Для того чтобы такие решения принимать не наобум, по вдохновению, а трезво, с открытыми глазами, современная наука располагает рядом приемов. Каким из них воспользоваться — зависит от того, какова природа неизвестных факторов ?, откуда они возникают и кем контролируются. Другими словами, с какого вида неопределенностью мы в данной задаче сталкиваемся?

У читателя может возникнуть вопрос: неужели можно классифицировать неопределенности по «родам» и «сортам»? Оказывается, можно.

Прежде всего, рассмотрим наиболее благоприятный для исследования, так сказать, «доброкачественный» вид неопределенности. Это случай, когда неизвестные факторы ? представляют собой обычные объекты изучения теории вероятностей — случайные величины (или случайные функции), статистические характеристики которых нам известны или в принципе могут быть получены к нужному сроку. Такие задачи исследования операций мы будем называть стохастическими задачами, а присущую им неопределенность — стохастической неопределенностью.

Приведем пример стохастической задачи исследования операций. Пусть организуется или реорганизуется работа столовой с целью повысить ее пропускную способность. Нам в точности неизвестно, какое количество посетителей придет в нее за рабочий день, когда именно они будут появляться, какие блюда заказывать и сколько времени будет продолжаться обслуживание каждого из них.

Однако характеристики этих случайных величин, если сейчас еще не находятся в нашем распоряжении, могут быть получены статистическим путем.

Другой пример: организуется система профилактического и аварийного ремонта технических устройств с целью уменьшить простои техники за счет неисправностей и ремонтов. Отказы техники, длительности ремонтов и профилактик носят случайный характер. Характеристики всех случайных факторов, входящих в задачу, могут быть получены, если собрать соответствующую статистику.

Рассмотрим более подробно этот «доброкачественный» вид неопределенности. Пусть неизвестные факторы ? представляют собой случайные величины с какими-то, в принципе известными, вероятностными характеристиками — законами распределения, математическими ожиданиями, дисперсиями и т. п. Тогда показатель эффективности W, зависящий от этих факторов, тоже будет величиной случайной. Максимизировать случайную величину невозможно: при любом решении х она остается случайной, неконтролируемой. Как же быть?

Первое, что приходит в голову: а нельзя ли заменить случайные факторы ? их средними значениями (математическими ожиданиями)? Тогда задача становится детерминированной и может быть решена обычными методами.

Что и говорить — прием соблазнительный и в некоторых случаях даже оправданный. Ведь на практике, решая большинство задач физики, механики, техники, мы сплошь и рядом им пользуемся, пренебрегая случайностью ряда параметров (теплоемкость, индуктивность, коэффициент трения) и заменяя их средними значениями. Весь вопрос в том, насколько случайны эти параметры: если они мало отклоняются от своих математических ожиданий, так поступать можно и нужно. Так же обстоит дело и в исследовании операций: есть задачи, в которых случайностью можно пренебречь. Например, если мы составляем план снабжения группы предприятий сырьем (см. пример 1 § 1), можно в первом приближении пренебречь, скажем, случайностью фактической производительности источников сырья (если, разумеется, его производство хорошо налажено).

Тот же прием — пренебречь случайностью и заменить все входящие в задачу случайные величины их математическими ожиданиями — будет уже опрометчивым, если влияние случайности па интересующий нас исход операции существенно. Возьмем самый грубый пример: пусть мы ведем обстрел какой-то цели, стремясь, во что бы то пи стало попасть в нее. Производится несколько выстрелов. Давайте, заменим все случайные координаты точек попадания их математическим ожиданием — центром цели. Получится, что любой выстрел с гарантией попадет в цель, что заведомо неверно. Другой, менее очевидный, пример: планируется работа ремонтной мастерской, обслуживающей автобазу. Пренебрежем случайностью момента появления неисправности (т. е. заменим случайное время безотказной работы машины его математическим ожиданием) и случайностью времени выполнения ремонта. И что же окажется? Мастерская, работа которой спланирована без учета случайности, попросту не будет справляться со своей задачей (в этом мы убедимся в главе 6). Встречаются (и очень часто) операции, в которые случайность входит по существу, и свести задачу к детерминированной не удается.

Итак, рассмотрим такую операцию O, где факторы ? «существенно случайны» и заметно влияют на показатель эффективности W, который тоже «существенно случаен».

Возникает мысль: надо взять в качестве показателя эффективности среднее значение (математическое ожидание) этой случайной величины W= M[W] и выбрать

такое решение х, при котором этот усредненный по условиям показатель обращается в максимум:

Заметим, что именно так мы поступали в § 2, выбирая в качестве показателя эффективности в задачах, содержащих неопределенность, не просто «доход», а «средний доход», не просто «время», а «среднее время». В большинстве случаев такой подход (мы его назовем «оптимизацией в среднем») вполне оправдан. В самом деле, если мы выберем решение так, чтобы среднее значение показателя эффективности обращалось в максимум, то, безусловно, поступим правильнее, чем, если бы выбирали решение наобум.

А как же с элементом неопределенности? Конечно, в какой- то мере он сохраняется. Эффективность каждой отдельной операции, проводимой при конкретных значениях случайных факторов ?, может сильно отличаться от ожидаемой как в большую, так, к сожалению, и в меньшую сторону. Нас может утешить то, что, оптимизируя операцию «в среднем», мы, в конечном счете, после многих ее повторений выиграем больше, чем, если бы совсем не пользовались расчетом.

Такая «оптимизация в среднем» очень часто применяется на практике в стохастических задачах исследования операций, и пользуются ею обычно не задумываясь над ее правомочностью. А задуматься надо! Чтобы этот прием был законным, нужно, чтобы операция обладала свойством повторяемости, и «недостача» показателя эффективности в одном случае компенсировалась его «избытком» в другом. Например, если мы предпринимаем длинный ряд однородных операций с целью получить максимальный доход, то доходы от отдельных операций суммируются, «минус» в одном случае покрывается «плюсом» в другом, и все в порядке.

Всегда ли это будет так? Нет, не всегда! Чтобы убедиться в этом, рассмотрим пример. Организуется автоматизированная система управления (АСУ) для службы неотложной медицинской помощи большого города. Вызовы, возникающие в разных районах города в случайные моменты, поступают на центральный пункт управления, откуда они передаются на тот или другой пункт неотложной помощи с приданными ему машинами. Требуется разработать такое правило (алгоритм) диспетчерской работы АСУ, при котором служба в целом будет функционировать наиболее эффективно. Для этого, прежде всего, надо выбрать показатель эффективности W.

Разумеется, желательно, чтобы время Т ожидания врача было минимально. Но это время — величина случайная. Если применить «оптимизацию в среднем», то надо выбрать тот алгоритм, при котором среднее время ожидания минимально. Не так ли?

Оказывается, не совсем так! Беда в том, что времена ожидания врача отдельными больными не суммируются: слишком долгое ожидание одного из них не компенсируется почти мгновенным обслуживанием другого.

Выбирая в качестве показателя эффективности среднее время ожидания Т, мы рискуем дать предпочтение тому алгоритму, при котором среднее-то время ожидания мало, но отдельные больные могут ожидать врача очень долго! Чтобы избежать таких неприятностей, можно дополнить показатель эффективности добавочным требованием, чтобы фактическое время Т

ожидания врача было не больше какого-то предельного значения t0. Поскольку Т — величина случайная, нельзя просто потребовать, чтобы выполнялось условие Т

Р (Т

Введение такого ограничения означает, что из области возможных решений Х исключаются решения, ему не удовлетворяющие. Ограничения типа (5.3) называются стохастическими ограничениями; наличие таких ограничений сильно усложняет задачу оптимизации.

Особенно осторожным надо быть с «оптимизацией в среднем», когда речь идет не о повторяемой, массовой операции, а о единичной, «уникальной». Все зависит от того, к каким последствиям может привести неудача данной операции, т. е. слишком малое значение показателя эффективности W; иногда оно может означать попросту катастрофу. Что толку в том, что операция в среднем приносит большой выигрыш, если в данном, единичном случае она может нас дотла разорить? От таких катастрофических результатов можно опять-таки спасаться введением стохастических ограничений. При достаточно большом значении уровня доверия

Итак, мы вкратце рассмотрели случай «доброкачественной» (стохастической) неопределенности и в общих чертах осветили вопрос об оптимизации решения в таких задачах.

Но это, как говорится, цветочки, ягодки будут впереди! Стохастическая неопределенность — это почти определенность, если только известны вероятностные характеристики входящих в задачу случайных факторов. Гораздо хуже обстоит дело, когда неизвестные факторы ? не могут быть изучены и описаны статистическими методами. Это бывает в двух случаях: либо а) распределение вероятностей для параметров 1 в принципе существует, но к моменту принятия решения не может быть получено, либо б) распределение вероятностей для параметров ? вообще не существует.

Пример ситуации типа а): проектируется информационно-вычислительная система (ИВС), предназначенная для обслуживания каких-то случайных потоков требований (запросов). Вероятностные характеристики этих потоков требований в принципе могли бы быть получены из статистики, если бы данная ИВС (или аналогичная ей) уже существовала и функционировала достаточно долгое время. Но к моменту создания проекта такой информации нет, а решение принимать надо! Как быть?

Разумеется, можно заранее (из умозрительных соображений) задаться какими-то характеристиками случайных факторов ? оптимизировать решение х

на этой основе (просто «в среднем» или при стохастических ограничениях) и остановиться па нем. Это будет, безусловно, лучше, чем выбрать решение наобум, но не намного лучше. Гораздо разумнее будет применить следующий прием: оставить некоторые элементы решения х свободными, изменяемыми. Затем выбрать для начала какой-то вариант решения, зная заведомо, что он не самый лучший, и пустить систему в ход, а потом, по мере накопления опыта, целенаправленно изменять свободные параметры решения, добиваясь того, чтобы эффективность не уменьшалась, а увеличивалась. Такие совершенствующиеся в процессе применения алгоритмы управления называются адаптивными. Преимущество адаптивных алгоритмов в том, что они не только избавляют пас от предварительного сбора статистики, по н перестраиваются в ответ па изменение обстановки. По мере накопления опыта такой алгоритм постепенно улучшается, подобно тому, как живой человек «учится па ошибках».

Теперь обратимся к самому трудному и неприятному случаю б), когда у неопределенных факторов ? вообще не существует вероятностных характеристик;

другими словами, когда их нельзя считать «случайными» в обычном смысле слова.

— Как? — может быть, спросит читатель.— Разве не всякая неопределенность есть случайность?

— Нет,— ответим мы,— лучше не путать эти понятия.

Поясняем: под термином «случайное явление» в теории вероятностей принято понимать явление, относящееся к классу повторяемых и, главное, обладающее свойством статистической устойчивости. При повторении однородных опытов, исход которых случаен, их средние характеристики проявляют тенденцию к устойчивости, стабилизируются. Частоты событий приближаются к их вероятностям, средние арифметические — к математическим ожиданиям. Если много раз бросать монету, частота появления герба постепенно стабилизируется, перестает быть случайной; если много раз взвешивать па аналитических весах одно и то же тело, средний результат перестает колебаться, выравнивается. Это пример доброкачественной, стохастической неопределенности.

Однако бывает неопределенность и нестохастнческого вида, которую мы условно назовем «дурной неопределенностью». Несмотря на то, что факторы t заранее неизвестны, не имеет смысла говорить об их «законах распределения» или других вероятностных характеристиках.

Пример: допустим, планируется некая торгово-промышленная операция, успех которой зависит от того, юбки какой длины ? будут носить женщины через два года. Распределение вероятностей для величины ? в принципе не может быть получено ни из каких статистических данных. Даже если рассмотреть великое множество опытов (годов), начиная с тех отдаленных времен, когда женщины впервые надели юбки, и в каждом из них зарегистрировать величину ?, это вряд ли поможет нам в нашем прогнозе. Вероятностное распределение величины ? попросту не существует, так как не существует массива однородных опытов, где она обладала бы должной устойчивостью. Налицо случай «дурной неопределенности».

Как же все-таки быть в таких случаях? Отказаться вообще от применения математических методов и выбрать решение «волевым» образом? Нет, этого делать не стоит. Некоторую пользу предварительные расчеты могут принести даже в. таких скверных условиях.

Давайте поразмышляем на эту тему. Пусть выбирается решение х

в какой-то операции O,

условия которой содержат «дурную неопределенность» — параметры ?, относительно которых никаких сведений мы не имеем, а можем делать лишь предположения. Попробуем все же решить задачу.

Первое, что приходит в голову: а ну-ка, зададимся какими-то, более или менее правдоподобными, значениями параметров ?. Тогда задача перейдет в категорию детерминированных и может быть решена обычными методами (детерминированный случай, со всеми его трудностями, представляется нам теперь чуть ли не «курортом»!).

Нет, радоваться рано. Допустим, что, затратив много усилий и времени (своего и машинного), мы это сделали. Ну и что? Будет ли найденное решение хорошим для других условий ?. Как правило, нет. Поэтому ценность его — сугубо ограниченная. В данном случае разумно будет выбрать не решение х,

оптимальное для каких-то условий ?, а некое компромиссное решение, которое, не будучи оптимальным, может быть, ни для каких условий, будет все же приемлемым в целом их диапазоне.

В настоящее время полноценной научной теории компромисса не существует, хотя некоторые попытки в этом направлении в теории игр и статистических решений делаются (см. главу 8). Обычно окончательный выбор компромиссного решения осуществляется человеком. Опираясь па предварительные расчеты, в ходе которых решается большое число прямых задач исследования операций для разных условий ? и разных вариантов решения х, он может оценить сильные и слабые стороны каждого варианта и на этой основе сделать выбор. Для этого необязательно (хотя иногда и любопытно) знать точный «условный» оптимум для каждой совокупности условий ?. Математические вариационные методы в данном случае отступают на задний план.

Подчеркнем еще одну полезную функцию предварительных математических расчетов в задачах с «дурной неопределенностью»: они помогают заранее отбросить те решения х

иногда — свести его к небольшому числу вариантов, которые легко могут быть просмотрены и оценены человеком в поисках удачного компромисса.

При рассмотрении задач исследования операций с «дурной неопределенностью» всегда полезно сталкивать в споре разные подходы, разные точки зрения. Среди последних надо отметить одну, часто применяемую в силу своей математической определенности, которую можно назвать «позицией крайнего пессимизма». Она сводится к тому, что, принимая решение в условиях «дурной неопределенности», надо всегда рассчитывать на худшее и принимать то решение, которое дает максимальный эффект в наихудших условиях. Если в этих условиях мы получаем выигрыш W =

Вряд ли такому военачальнику будет сопутствовать удача! Напротив, в любой конкретной ситуации нужно стараться угадать, в чем слаб и «глуп» противник, и стараться «обвести его вокруг пальца». Тем менее уместен крайне пессимистический подход в ситуациях, где стороне, принимающей решение, не противостоят никакие враждебные силы. Расчеты, основанные на точке зрения «крайнего пессимизма», всегда должны корректироваться разумной долей оптимизма. Вряд ли стоит становиться и на противоположную точку зрения — крайнего пли «залихватского» оптимизма, но известная доля риска при принятии решения все же должна присутствовать. Нельзя также забывать о том, что любое решение, принятое в условиях «дурной неопределенности»,— неизбежно плохое решение, и вряд ли стоит обосновывать его с помощью тонких и кропотливых расчетов. Скорее следует подумать о том, откуда можно было бы взять недостающую информацию. Здесь все способы хороши — лишь бы прояснить положение.

Упомянем в этой связи об одном довольно оригинальном методе, не пользующемся любовью в среде чистых математиков, но тем не менее полезном, а иногда — единственно возможном. Речь идет о так называемом методе экспертных оценок. Он часто применяется в задачах, связанных с прогнозированием в условиях дурной неопределенности (например, в футурологии). Грубо говоря, идея метода сводится к следующему: собирается коллектив сведущих, компетентных в данной области людей, и каждому из них предлагается ответить на какой-то вопрос (например, назвать срок, когда будет совершено то или другое открытие, пли оценить вероятность того или другого события). Затем полученные ответы обрабатываются наподобие статистического материала. Результаты обработки, разумеется, сохраняют субъективный характер, но в гораздо меньшей степени, чем, если бы мнение высказывал один эксперт («ум хорошо, а два — лучше»). Подобного рода экспертные оценки для неизвестных условий могут быть применены и при решении задач исследования операций с дурной неопределенностью. Каждый из экспертов па глаз оценивает степень правдоподобия различных вариантов условий 1, приписывая им какие-то субъективные вероятности.

Несмотря на субъективный характер оценок каждого эксперта, усредняя оценки целого коллектива, можно получить нечто более объективное и полезное (кстати, оценки разных экспертов расходятся не так сильно, как можно было бы ожидать). Таким образом, задача с дурной неопределенностью как бы сводится к обычной стохастической задаче. Разумеется, к полученным отсюда выводам не надо относиться слишком доверчиво, но наряду с другими результатами, вытекающими из других точек зрения, но все же могут помочь при выборе решения.

Наконец, сделаем одно общее замечание. При обосновании решения в условиях неопределенности, что бы мы ни делали, элемент неопределенности, «гадательности» сохраняется. Поэтому нельзя предъявлять к точности решений слишком высокие требования. Вместо того чтобы указать одно-единственное, в точности «оптимальное» (с какой-то точки зрения) решение, лучше выделить целую область «приемлемых» решений, которые оказываются несущественно хуже других, какой бы точкой зрения мы ни пользовались. В пределах этой области и должны производить свой окончательный выбор ответственные за это люди. Исследователь, предлагая им рекомендации по выбору решения, всегда должен одновременно указывать точки зрения, из которых вытекают те или другие рекомендации.

§ 6. Многокритериальные задачи исследования операций. «Системный подход»

Несмотря на ряд существенных трудностей, связанных с неопределенностью, мы до сих пор рассматривали только самые простые случаи, когда ясен критерий, по которому производится оценка эффективности, и требуется обратить в максимум (минимум) один-единственный показатель W. К сожалению, на практике такие задачи, где критерий оценки однозначно диктуется целевой направленностью операции, встречаются не так уж часто — преимущественно при рассмотрении небольших по масштабу и скромных по значению мероприятий. А когда идет речь о крупномасштабных, сложных операциях, затрагивающих разнообразные интересы их организаторов и общества в целом, то их эффективность, как правило, не может быть полностью охарактеризована с помощью одного-• единственного показателя эффективности W. На помощь ему приходится привлекать другие, дополнительные.

Такие задачи исследования операций называются многокритериальными.

Рассмотрим пример такой задачи. Организуется оборона важного объекта от воздушных налетов. В нашем распоряжении — какие-то средства противовоздушной обороны, которые надо разумным образом разместить вокруг объекта, организовать их взаимодействие, распределить между ними цели, назначить боезапас и т. д. Допустим, что каждый из самолетов противника, участвующих в налете, является потенциальным носителем мощного поражающего средства, которое, будучи применено по объекту, гарантирует его уничтожение. Тогда главная задача операции — не допустить к объекту ни одного самолета, а естественный показатель эффективности — вероятность W того, что ни один самолет не прорвется к объекту. Но единственный ли это важный для нас показатель? Безусловно, нет. При одной и той же вероятности W мы предпочтем все-таки решение, при котором будет погибать в среднем побольше самолетов противника. Отсюда второй показатель эффективности М — среднее число пораженных целей, который нам тоже хотелось бы максимизировать. Кроме того, нам далеко не все равно, каковы будут наши собственные боевые потери П — еще один критерий, который хотелось бы минимизировать. Желательно было бы, кроме того, сделать поменьше средний расход боеприпасов R, и т. д.

Другой пример — на этот раз из совершенно мирной области. Организуется (или реорганизуется) работа промышленного предприятия. Под углом зрения какого критерия надо выбирать решение? С одной стороны, нам хотелось бы обратить в максимум валовый объем продукции V. Желательно также было бы получить максимальный чистый доход D. Что касается себестоимости S, то ее хотелось бы обратить в минимум, а производительность труда П — в максимум. При обдумывании задачи может возникнуть еще ряд дополнительных критериев.

Такая множественность показателей эффективности, из которых одни желательно обратить в максимум, а другие — в минимум, характерна для любой сколько-нибудь сложной задачи исследования операций.

Предлагаем читателю в виде упражнения попытаться сформулировать ряд критериев, по которым будет оцениваться работа автобусного парка. Подумайте о том, какой из них, с вашей точки зрения, является главным (теснее всего связанным с целевой направленностью операции), а остальные (дополнительные) расположите в порядке убывающей важности. На этом примере можно убедиться в том, что а) ни один из показателей не может быть выбран в качестве единственного и б) формулировка системы показателей — не такая уж простая задача... И сами показатели, и их упорядоченность по важности зависят от того, с точки зрения, чьих интересов оптимизируется решение.

Итак, типичной для крупномасштабной задачи исследования операций является многокритериальность — наличие ряда количественных показателей W1, W2,…, одни из которых желательно обратить в максимум, другие — в минимум («чтобы и волки были сыты, и овцы целы»).

Спрашивается, можно ли найти решение, одновременно удовлетворяющее всем этим требованиям? Со всей откровенностью ответим: нет. Решение, обращающее в максимум один какой-то показатель, как правило, не обращает ни в максимум, ни в минимум другие. Поэтому часто применяемая формулировка: «достигнуть максимального эффекта при минимальных затратах» представляет собой не более чем фразу и при научном анализе должна быть отброшена.

Как же быть в случае, если все же приходится оценивать эффективность операции по нескольким показателям?

Люди, малоискушенные в исследовании операции, обычно торопятся свести многокритериальную задачу к однокритериальной: составляют какую-то функцию от всех показателей и рассматривают ее как один, «обобщенный» показатель, по которому и оптимизируется решение. Часто такой обобщенный показатель имеет вид дроби, в числителе которой стоят все величины, увеличение которых желательно, а в знаменателе — то, увеличение которых нежелательно. Например, продуктивность и доход — в числителе, время выполнения и расходы — в знаменателе и т. д.

Такой способ объединения нескольких показателей в один не может быть рекомендован, и вот почему: он основан на неявном допущении, что недостаток в одном показателе всегда может быть скомпенсирован за счет другого; например, малая продуктивность — за счет низкой стоимости и т.

д. Это, как правило, несправедливо.

Вспомним «критерий для оценки человека», полушутя-полусерьезно предложенный когда- то Львом Толстым. Он имеет вид дроби, в числителе которой стоят действительные достоинства человека, а в знаменателе — его мнение о себе. С первого взгляда такой подход может показаться логичным. Но представим себе человека, почти совсем не имеющего достоинств, по совсем не обладающего самомнением. По критерию Л. Н. Толстого такой человек должен иметь бесконечно большую ценность, с чем уж никак согласиться нельзя.

К подобным парадоксальным выводам может привести (и нередко приводит) пользование показателем в виде дроби, где, как говорят, все, что «за здравие»,— в числителе, все, что «за упокой»,— в знаменателе.

Нередко применяется и другой, чуть более замысловатый, способ составления «обобщенного показателя эффективности»— он представляет собой «взвешенную сумму» частных показателей, в которую каждый из них Wi входит с каким-то «весом» ai, отражающим его важность:

W =a1 W1

+a2 W2 +... (6.1)

(для тех показателей, которые желательно увеличить, веса берутся положительными, уменьшить — отрицательными).

При произвольном назначении весов a1, а2, ... этот способ ничем не лучше предыдущего (разве тем, что обобщенный критерий не обращается в бесконечность). Его сторонники ссылаются на то, что и человек, принимая компромиссное решение, тоже мысленно взвешивает все «за» и «против», приписывая больший вес более важным для него факторам. Это, может быть, и так, но, по-видимому, «весовые коэффициенты», с которыми входят в расчет разные показатели, не постоянны, а меняются в зависимости от ситуации.

Поясним это элементарным примером. Человек выходит из дому, чтобы ехать на работу, боится опоздать и размышляет: каким транспортом воспользоваться? Трамвай ходит часто, но идет долго; автобус — быстрее, но с большими интервалами. Можно, конечно, взять такси, но это обойдется дорого. Есть еще такое решение: часть пути проехать на метро, а затем взять такси.

Но на стоянке может не быть машин, а, добираясь до работы со станции метро пешком, он рискует опоздать больше, чем, если бы ехал автобусом. Как ему поступить?

Перед нами типичная (намеренно упрощенная) задача исследования операций с двумя критериями (показателями). Первый — среднее ожидаемое время опоздания Т,

которое хотелось бы сделать минимальным. Второй — ожидаемая стоимость проезда S; ее тоже желательно сделать минимальной. Но эти два требования, как мы знаем, несовместимы, поэтому человек должен принять компромиссное, приемлемое по обоим критериям, решение. Возможно, он при этом подсознательно взвешивает все «за» и «против», пользуясь чем-то вроде обобщенного показателя:

W = a1 T + a2 S => min. (6.2)

Но беда в том, что весовые коэффициенты а1, а2 никак нельзя считать постоянными. Они зависят как от самих величин Т

и S, так и от обстановки. Например, если человек недавно уже получил выговор за опоздание, коэффициент при Т у него, вероятно, увеличится, а на другой день после получки, вероятно, уменьшится коэффициент при S.

Если же назначать (как это обычно и делается) веса а1, а2

произвольно, то, по существу, столь же произвольным будет и вытекающее из них «оптимальное» решение.

Здесь мы встречаемся с очень типичным для подобных ситуаций приемом — «переносом произвола из одной инстанции в другую». Простой выбор компромиссного решения на основе мысленного сопоставления всех «за» и «против» каждого решения кажется слишком произвольным, недостаточно «научным». А вот маневрирование с формулой, включающей (пусть столь же произвольно назначенные) коэффициенты а1, а2, ...,—совсем другое дело. Это уже «наука»! По существу же никакой науки тут нет, и нечего обманывать самих себя.

«Гони природу в дверь — она влетит в окно». Нечего надеяться полностью, избавиться от субъективности в задачах, связанных с выбором решений. Даже в простейших, однокритериальных задачах она неизбежно присутствует, проявляясь хотя бы в выборе показателя эффективности и математической модели явления.

Тем более неизбежна субъективность ( грубо говоря, произвол) при выборе решения в многокритериальной задаче. Правда, бывают редкие случаи, когда достаточно ознакомиться со значениями всех показателей для каждого варианта, чтобы сразу стало ясно, какой из них выбрать. Представим себе, например, что какой-то вариант решения х имеет преимущество над другими по всем показателям; ясно, что именно его следует предпочесть. Но гораздо чаще встречаются случаи, когда с первого взгляда ситуация неясна: один из показателей тянет в одну сторону, другой — в другую. При этом всегда полезно провести дополнительные расчеты, пользуясь, может быть, даже формулами типа (6.1), но, не доверяя им слепо, а сохраняя к ним критическое отношение.

Выходит, что математический аппарат не может нам ничем помочь при решении многокритериальных задач? Отнюдь нет, он может помочь, и очень существенно. Прежде всего, он позволяет решать прямые задачи исследования операций, т. е. для любого решения х находить значения показателей эффективности W1, W2, ..., сколько бы их ни было (кстати, для прямых задач многокритериальность — не помеха). И во-вторых, что особенно важно, он помогает «выбраковать» из множества возможных решений Х заведомо неудачные, уступающие другим по всем критериям.

Покажем, как это, в принципе, делается. Пусть имеется многокритериальная задача исследования операций с k критериями. W1, W2, …, Wk. Для простоты предположим, что все эти величины желательно максимизировать (как переходить от «минимума» к «максимуму», мы уже знаем). Пусть в составе множества возможных решений есть два решения х1 и х2 такие, что все критерии W1, W2, .., Wk для первого решения больше или равны соответствующим критериям для второго решения, причем хотя бы один из них действительно больше. Очевидно, тогда в составе множества Х нет смысла сохранять решение х2, оно вытесняется (или, как говорят, «доминируется») решением х1.

Ладно, выбросим, решение x2 как неконкурентоспособное и перейдем к сравнению других по всем критериям.

В результате такой процедуры отбрасывания заведомо непригодных, невыгодных решений множество Х обычно сильно уменьшается: в нем сохраняются только так называемые эффективные (иначе «паретовские») решения, характерные тем, что ни для одного из них не существует доминирующего решения.

Проиллюстрируем прием выделения паретовских решений на примере задачи с двумя критериями: W1 и W2 (оба требуется максимизировать). Множество Х состоит из конечного числа п возможных решений х1, x2, ..., xn. Каждому решению соответствуют определенные значения показателей W1, W2; будем изображать решение точкой на плоскости с координатами W1, W2 и занумеруем точки соответственно номеру решения (рис. 6.1).

|

лежащие на правой верхней границе области возможных решений (см. жирные точки, соединенные пунктиром, на рис. 6.1). Для всякого другого решения существует хотя бы одно доминирующее, для которого либо W1, либо W2, либо оба больше, чем для данного. И только для решений, лежащих на правой верхней границе, доминирующих не существует.

Когда из множества возможных решений выделены эффективные, «переговоры» могут вестись уже в пределах этого - «эффективного» множества. На рис. 6.1 его образуют четыре решения: x2, x5, х10

и x11; из них x11 — наилучшее по критерию W1, х2 — по критерию W2. Дело лица, принимающего решение, выбрать тот вариант, который для него предпочтителен и «приемлем» по обоим критериям.

Аналогично строится множество эффективных решений и в случае, когда показателей не два, а больше (при числе их, большем трех, геометрическая интерпретация теряет наглядность, но суть дела сохраняется). Множество эффективных решений легче обозримо, чем множество X. Что касается окончательного выбора решения, то он по-прежнему остается прерогативой человека. Только человек, с его непревзойденным умением решать неформальные задачи, принимать так называемые «компромиссные решения» (не строго-оптимальные, но приемлемые по ряду критериев) может взять на себя ответственность за окончательный выбор.

Однако сама процедура выбора решения, будучи повторена неоднократно, может послужить основой для выработки некоторых формальных правил, применяемых уже без участия человека. Речь идет о так называемых «эвристических» методах выбора решений. Предположим, что опытный человек (или, еще лучше, группа опытных людей) многократно выбирает компромиссное решение в многокритериальной задаче исследования операций, решаемой при разных условиях а. Набирая статистику по результатам выбора, можно, например, разумным образом подобрать значения «весов» a1, a2, … в формуле. (6.1), в общем случае зависящие от условий » и самих показателей W1, W2, ..., и воспользоваться таким обобщенным критерием для выбора решения, на этот раз уже автоматического, без участия человека. На это иногда приходится идти в случаях, когда времени на обдумывание компромиссного решения нет (например, в условиях боевых действий), или же в случае, когда выбор решения передается автоматизированной системе управления (АСУ).

В некоторых случаях очень полезной оказывается процедура выбора решения в так называемом «диалоговом режиме», когда машина, произведя расчеты, выдает лицу (лицам), управляющему операцией, значения показателей W1, W2, ..., а это лицо, критически оценив ситуацию, вносит изменения в весовые коэффициенты (или иные параметры управляющего алгоритма).

Существует один, часто применяемый способ свести многокритериальную задачу к однокритериальной — это выделить один (главный) показатель W1 и стремиться его обратить в максимум, а на все остальные W2, W3, ... наложить только некоторые ограничения, потребовав, чтобы они были не меньше каких-то заданных w2, w3, … Например, при оптимизации плана работы предприятия можно потребовать, чтобы прибыль была максимальна, план по ассортименту — выполнен или перевыполнен, а себестоимость продукции — не выше заданной. При таком подходе все показатели, кроме одного — главного, переводятся в разряд заданных условий ос. Известный произвол в назначении границ w2, w3, ..., разумеется, при этом остается; поправки в эти границы тоже могут быть введены в «диалоговом режиме».

Существует еще один путь построения компромиссного решения, который можно назвать «методом последовательных уступок». Предположим, что показатели W1, W2,... расположены в порядке убывающей важности. Сначала ищется решение, обращающее в максимум первый (важнейший) показатель W1 = W1*. Затем назначается, исходя из практических соображений, с учетом малой точности, с которой нам известны входные данные, некоторая «уступка»

Так или иначе, при любом способе ее постановки, задача обоснования решения по нескольким показателям остается не до конца формализованной, и окончательный выбор решения всегда определяется волевым актом «командира» (так можно условно назвать ответственное за выбор лицо). Дело исследователя — предоставить в распоряжение командира данные, помогающие ему делать выбор не «вслепую», а с учетом преимуществ и недостатков каждого варианта решения 1).

* * *

В заключение скажем несколько слов о так называемом «системном подходе» к. задачам выбора решений.

В настоящее время в связи с ростом масштабов и сложности операций все чаще приходится решать задачи оптимального управления так называемыми «сложными системами», включающими большое число элементов и подсистем и организованными обычно по иерархическому принципу. Например, какая-то отрасль народного хозяйства включает относительно самостоятельные специализированные управления, которые, в свою очередь, имеют в своем подчинении предприятия (фабрики, заводы); каждое предприятие включает подразделения, цеха и проч.

Оптимизируя (с точки зрения какого- либо критерия) работу одного звена сложной системы, нельзя забывать о связях, имеющихся между разными звеньями системы, между разными уровнями иерархии. Нельзя вырывать из цепи одно звено и рассматривать его, забывая об остальных.